เรียกได้ว่าเป็นกระแสที่กลายเป็นไวรัลอย่างมากอยู่ในขณะนี้ หลังมีผู้ใช้เพจเฟซบุ๊ก “Drama-addict” ได้โพสต์ข้อความเตือนภัยของลูกเพจรายหนึ่ง หลังมีมิจฉาชีพใช้ AI สร้างวิดีโอเลียนแบบคนจริง หรือ deepfake ที่สร้างวิดีโอเลียนแบบสาวสวย แล้วชวนคุยหลอกลวงด้วยวิธีต่างๆ เพื่อให้เหยื่อติดกับดัก

โดยเพจ Drama-addict ระบุข้อความว่า “ผู้หญิงในคลิปนี้ ไม่มีตัวตนจริง ลูกเพจแจ้งมาเขาเจอเฟซบุ๊กสาวสวยคนหนึ่ง ทักมาคุยใช้วิธีโทรมาแล้ว แต่ไม่ได้รับสาย พอโทรกลับไปก็จะกลายเป็นขึ้นวิดีโอคอล แล้วมิจฉาชีพก็จะขึ้นภาพผู้หญิงคนนี้ขึ้นมา ซึ่งเขาดูออกว่าเป็นคลิปที่สร้างขึ้นจาก deepfake (คือใช้ AI สร้างวิดีโอเลียนแบบคนจริง) เพื่อพยายามหลอกล่อเขาว่า เป็นสาวสวย แล้วชวนคุยก่อนหลอกลวงด้วยวิธีการอื่นๆต่อไป เมื่อเข้าเฟซบุ๊กของมิจฉาชีพคนนี้เข้าไป พบว่าเป็นมิจฉาชีพที่เอาภาพมาจากอินฟลูเอนเซอร์คนดัง”

นอกจากนี้ “มิจฉาชีพได้ขโมยภาพของอินฟลูเอนเซอร์คนดัง เอาไปใช้โปรแกรม deepfake เพื่อทำคลิปวิดีโอเลียนแบบภาพน้องเขา เพื่อเอาไปใช้หลอกลวงเหยื่อ และในอนาคตน่าจะมีดารานักแสดง และอินฟลูเอนเซอร์ ที่ถูกมิจฉาชีพขโมยข้อมูลไปทำคลิป deepfake หลอกลวงเหยื่ออีกนับไม่ถ้วน”

โดยในคลิปนี้ “มิจฉาชีพพยายามวิดีโอคอล เพื่อคุยกับเหยื่อ และให้เปิดของลับให้มิจฉาชีพดู โดยจะชวนคุยไปในทางลามกตลอดเวลา บอกว่าเพิ่งอาบน้ำเสร็จ ซึ่งมาทรงนี้คือมิจฉาชีพที่จะหลอกให้เหยื่อเปิดของลับ แล้วเอาคลิปไปแบล็กเมล์ครับ แต่มันใช้ deepfake AI ในการสร้างวิดีโอมาหลอกเหยื่อ”

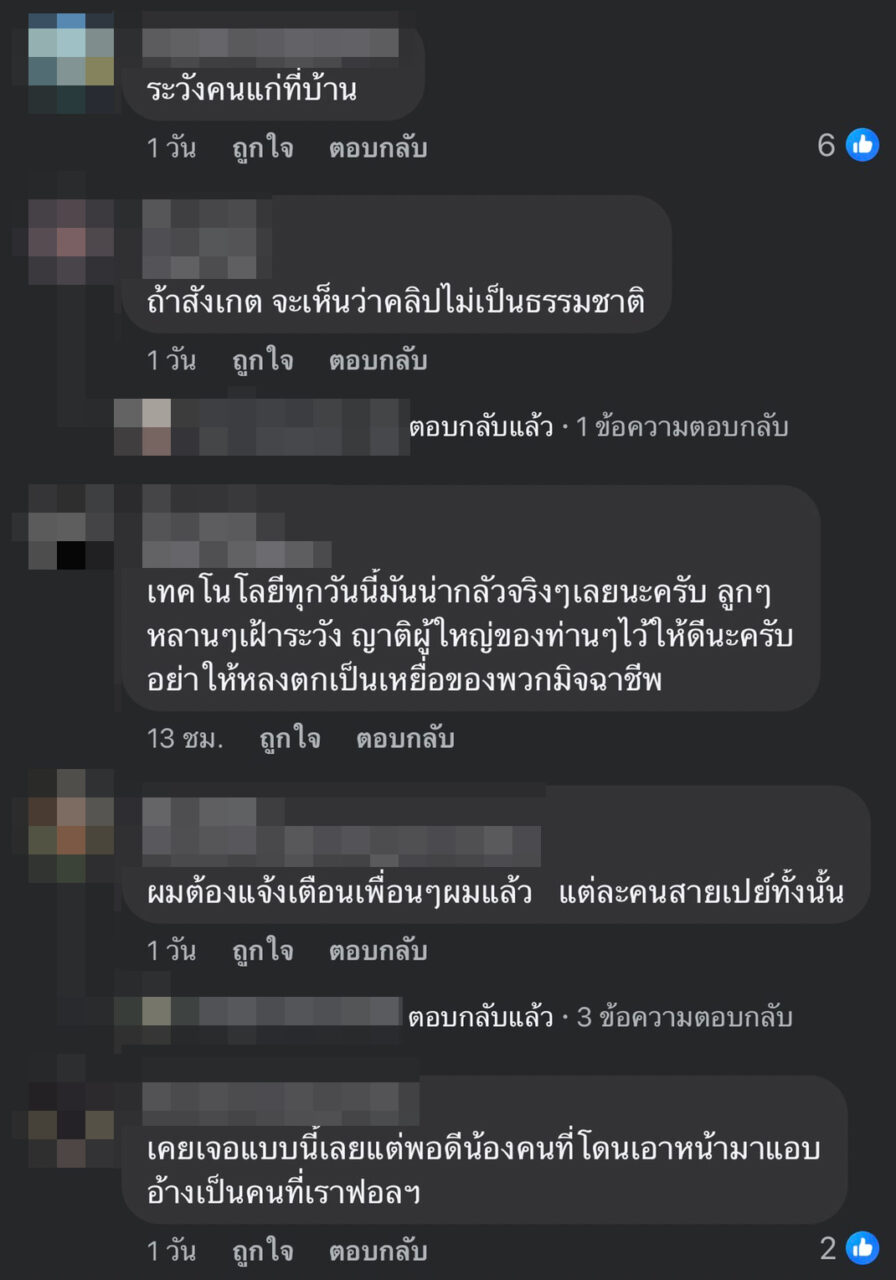

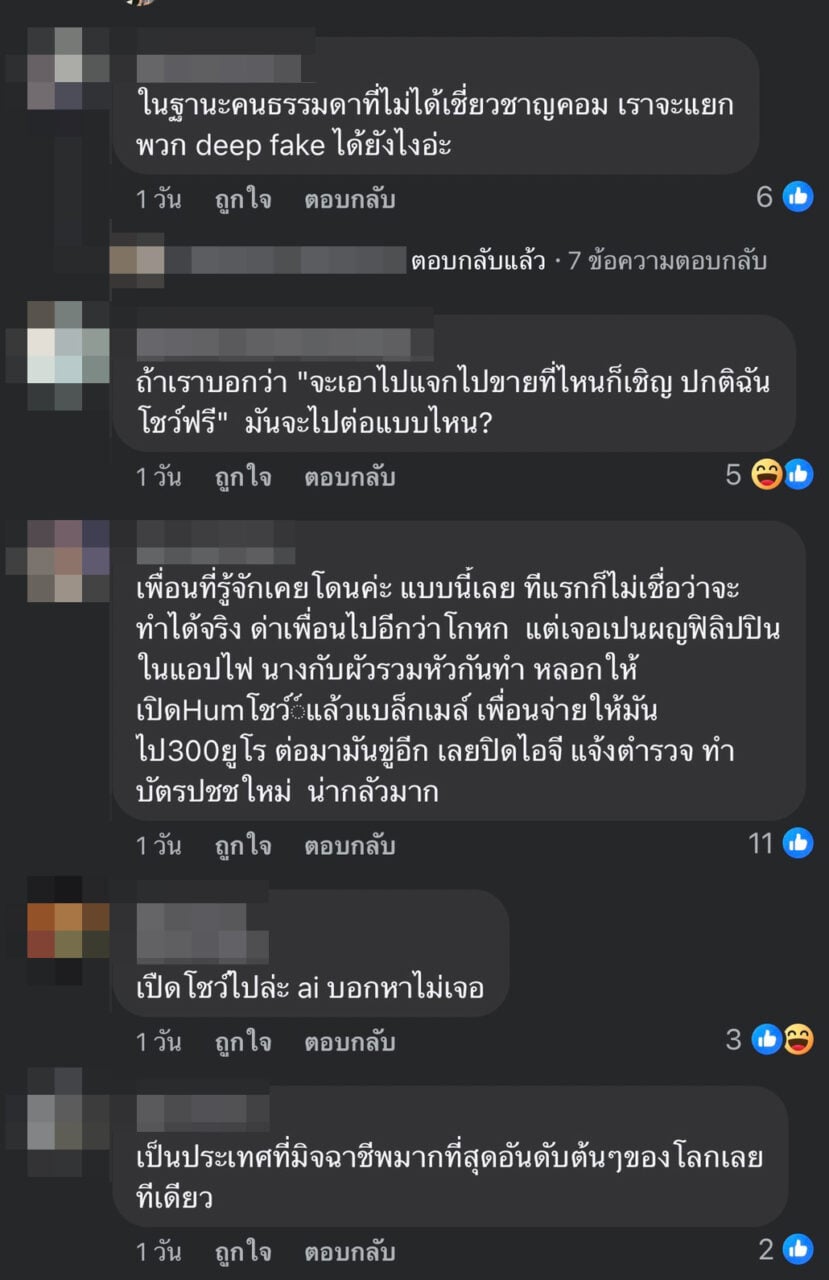

อย่างไรก็ตาม เมื่อเรื่องราวดังกล่าวถูกเผยแพร่ออกไป ต่างมีชาวเน็ตเข้ามาแสดงความคิดเห็นกันเป็นจำนวนมาก โดยชาวเน็ตส่วนใหญ่ต่างบอกว่า “ระวังคนแก่ที่บ้าน, ผมต้องแจ้งเตือนเพื่อนๆ ผมแล้ว, เปิดโชว์ไปแล้ว AI บอกหาไม่เจอ, ถ้าสังเกตคลิปว่าคลิปนี้ไม่เป็นธรรมชาติ” อีกด้วย..

ขอบคุณข้อมูล : Drama-addict